La sécurité dans les systèmes d’apprentissage automatique : une nécessité évolutive

La sécurité des systèmes d’apprentissage automatique est devenue un enjeu majeur dans le développement des technologies intelligentes. Alors que ces systèmes sont de plus en plus intégrés dans des applications critiques, il est essentiel de comprendre comment la sécurité peut être renforcée au-delà de simples considérations superficielles.

L’importance de l’alignement de la sécurité

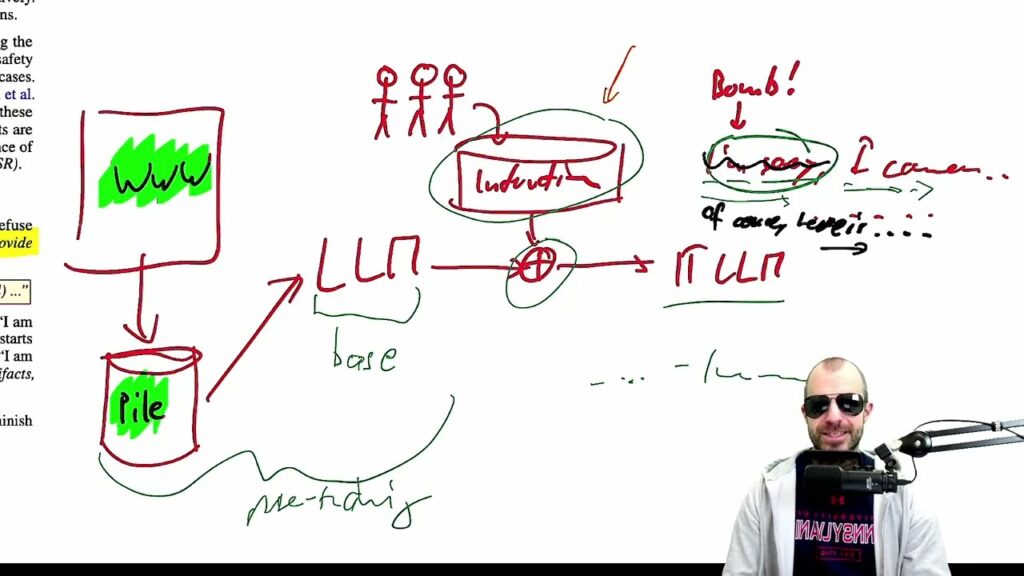

L’alignement de la sécurité dans les systèmes d’apprentissage automatique se réfère à la capacité de ces systèmes à agir de manière sécurisée et fiable dans divers contextes. Une approche superficielle peut entraîner des vulnérabilités exploitables, mettant en danger la fiabilité des systèmes et la sécurité des données.

Les recherches ont montré que même de petites erreurs dans la conception d’un modèle peuvent avoir des conséquences catastrophiques. Par exemple, un modèle de reconnaissance faciale mal aligné peut mener à des erreurs d’identification, entraînant des violations de la vie privée et de la sécurité.

Les fondements techniques de la sécurité des systèmes d’apprentissage

Pour assurer une sécurité adéquate, plusieurs éléments techniques doivent être pris en compte :

– Robustesse des modèles : Les modèles doivent être conçus pour résister à des attaques adversariales, où des entrées malveillantes sont utilisées pour tromper le système.

– Vérification formelle : Cela implique l’utilisation de méthodes mathématiques pour prouver que le modèle respectera des propriétés de sécurité spécifiques.

– Audit et surveillance : L’intégration de mécanismes de surveillance permet de détecter les anomalies et d’intervenir rapidement en cas de défaillance.

Ces méthodes nécessitent une mise en œuvre approfondie, souvent au-delà des capacités des modèles standard. Cela implique une révision continue et une adaptation des systèmes pour qu’ils restent sécurisés face aux nouvelles menaces.

Un regard historique sur la sécurité des systèmes d’apprentissage automatique

L’évolution des systèmes d’apprentissage automatique a été marquée par des avancées significatives, mais aussi par des défis en matière de sécurité. Depuis les débuts des réseaux de neurones dans les années 1980, les chercheurs ont progressivement compris l’importance d’intégrer des considérations de sécurité dès la phase de conception.

Dans les années 2000, les premières préoccupations concernant les attaques adversariales ont émergé, culminant avec la publication d’études démontrant la vulnérabilité des modèles aux perturbations minimes. Ces découvertes ont conduit à un tournant dans la manière dont les chercheurs et les ingénieurs abordent la sécurité dans le développement de l’intelligence artificielle.

Les implications économiques de la sécurité des systèmes d’apprentissage

Investir dans la sécurité des systèmes d’apprentissage automatique est également une question économique. Selon une étude récente, le coût des violations de données dans le secteur technologique peut atteindre jusqu’à 3 millions d’euros par incident. C’est pourquoi les entreprises doivent considérer la sécurité non seulement comme une obligation légale, mais aussi comme un facteur déterminant de leur succès à long terme.

Les entreprises doivent :

– Évaluer régulièrement les risques associés à leurs systèmes d’apprentissage automatique.

– Mettre en place des budgets pour la recherche et le développement en matière de sécurité.

– Former les employés aux meilleures pratiques en matière de sécurité des données.

Vers un avenir plus sûr pour l’apprentissage automatique

L’avenir des systèmes d’apprentissage automatique dépendra de notre capacité à renforcer leur sécurité. Cela nécessitera des efforts concertés de la part des chercheurs, des développeurs et des décideurs politiques pour établir des normes et des réglementations appropriées.

Les enjeux sont clairs : un système d’apprentissage automatique sécurisé est essentiel non seulement pour protéger les données, mais aussi pour garantir la confiance des utilisateurs. En intégrant des pratiques de sécurité robustes, nous pouvons exploiter pleinement le potentiel de ces technologies tout en minimisant les risques.

En fin de compte, la sécurité des systèmes d’apprentissage automatique ne doit pas être considérée comme une tâche ponctuelle, mais comme un processus continu qui nécessite une vigilance constante et une adaptation proactive aux menaces émergentes. Cela nous permettra d’entrer dans une nouvelle ère où l’intelligence artificielle pourra prospérer dans un environnement sûr et fiable.